常時HTTPS化やドメイン名移行をすると、各ページの「いいね!」数がゼロに戻る問題への1つの解決策を、今週はピックアップ。ほかにもnoindex、被リンク、EFO、「検索結果でフェイスブックページにリッチスニペット」、重複コンテンツ、パンダなどなどの情報をお届けする。

- 今週のピックアップ

- 日本語で読めるSEO/SEM情報

- 海外SEO情報ブログの掲載記事から

- 海外のSEO/SEM情報を日本語で

- SEO Japanはお休みです

常時HTTPSにすると過去記事のいいね!数がゼロになってしまう問題の解決策

完璧ではない(アユダンテ株式会社 コラム)

サイトをHTTPからHTTPSへ移行すると、それ以前の過去記事(公開当時はHTTPだった)の、HTTPのURLに付いていたソーシャルメディアのシェア数は HTTPSのURLには通常引き継がれない。つまり、HTTPS化すると、ソーシャルメディアのシェア数はゼロからの再スタートになってしまう。

「http」と「https」だけしか違わないとはいえ、ソーシャルメディア側は別のURLだとみなすからだ。

この問題の解決策をアユダンテさんが紹介している。

例はPHPを使った方法だが、わかりやすく言うと「HTTPSのページでも、未来永劫、HTTPのURLだとみなしてボタンを表示する」というものだ。

ソーシャルボタンには「どのURLの情報を表示するか」を指定する属性が用意されているので、そこにHTTPのURLを指定して表示するというわけだ。

なかなかよくできたやり方だ。

とはいえ、これが完璧な解決策だというわけではない。

ソーシャルボタンからシェアしてくれればいいが、URLを直接指定してシェアされたものは、ここにカウントされないからだ。

また、HTTPSなのに http:// でシェアされるという不整合は、元記事でも指摘されているし、筆者も心情としてしっくりこない。

同じ問題はドメイン名の変更時にも発生する。

本来ならば、同じドメイン名で同じパスであれば http:// と https:// が違っていても同一のURLだとみなすように、ソーシャルメディア側で対応してくれると嬉しいのだが。

+1ボタン/Google+ のシェア数は、HTTPSへの移行後に1回シェアされるとHTTPの時のカウント数と合算されるようなので、不可能ではないはずだ。

ちなみに筆者のブログは今年初めに常時HTTPSに移行した。ソーシャルメディアのシェア数はどうしたかというと、いい方法が見つからず結局ゼロからのスタートにした(あまりこだわっていなかったというのもあるが)。

日本語で読めるSEO/SEM情報

ヤフーがモバイル向けページだけをnoindexにするのには深い理由があるのか?

不一致を起こす設定は一般サイトでは避けるべき(辻正浩 on Twitter)

ヤフー検索がモバイル版ページにはnoindex robots meta タグを記述している不思議な構成を前回紹介した。

この構成を発見した辻氏は、Web担の記事に対して次のようなツイートを投稿した。

これアルゴリズム上出るのが正しいのか間違いなのか難しい所ですね。>スマホ版ページをnoindexにしてもスマホ検索には出る!?(スマホ対応ラベルも付く) など10+2記事 | 海外&国内SEO情報ウォッチ | Web担当者Forum http://t.co/g30L7BW1RH

— 辻正浩 | Masahiro Tsuji (@tsuj) 2015, 7月 4「スマホページを持っててスマホ検索でPCページと接続されたセット状態のは表示されても、いくつかのケースであるスマホページが単体でインデックスされる状況は絶対に防ぎたい!」というケースでは、今の仕様でスマホページにnoindexは有りかな。イレギュラーあり得るし私ならやりませんが。

— 辻正浩 | Masahiro Tsuji (@tsuj) 2015, 7月 4noindexではなくて、metaでnofollowをつけるのがベストプラクティスなケースは超巨大サイトの極めてイレギュラーな例でのみありえるかなーというのが私の考え。ちなみにYahoo!検索の検索結果URLはrobots.txtでブロックされていてそれが絶対正しいはず。

— 辻正浩 | Masahiro Tsuji (@tsuj) 2015, 7月 4一言でいえば、こういう使い方が想定されるケースはあるかもしれないが、意図したように機能するかどうかの保証がないので自分ならやらないということになるだろう。

一方、グーグルのジョン・ミューラー氏が英語版のオフィスアワーで参加者とこんなやりとりをしていた。

質問者: もし、PC向けページにはnoindexタグとnofollowタグが記述されていて、対応するモバイル向けページにはnofollowタグとfollowタグが記述されていたら、(noindexが付いた)PC向けページをPC検索でグーグルは表示しますか?

ミューラー氏: どちらにもnoindexが付いているから、どちらも検索結果には表示されないだろう。

しかし一般的には、不一致を起こすシグナルは常に避けたほうがいい。

もしそういったことをすれば、どう扱うか私たちが決定することになるだろう。そしてその決定は時間がたつと変わるかもしれない。

検索エンジンにこう扱ってほしいという意図があるのならば、ウェブマスターはそれを明確で一貫した形で示すべきだ。

ヤフーのケースとは内容が若干異なるが、重要なのは強調した部分だ。「片方(PC向けページ)はインデックスさせるが、もう片方(モバイル向けページ)はインデックスさせない」というような、相反する設定をすべきではないのだ。

ひょっとしたらグーグルからの直接のアドバイスを受けて、このような構成をヤフーは採用しているのかもしれない。だが筆者たちのサイトでは、このような構成も含めて、一貫性に欠ける設定は避けたほうがいいだろう。

外部サイトのJavaScriptがブロックされているとランキングに悪影響が出るか?

メインコンテンツに関係しなければ大丈夫(ウェブマスター向けヘルプフォーラム)

Search Consoleの「ブロックされたリソース」に、外部サイトに置いてあるJavaScriptがレポートされているのですが、検索結果に影響がありますか?

こういった内容の質問がウェブマスター向けヘルプフォーラムに投稿された。

ソーシャルボタンやアクセス解析ツール、広告などメインコンテンツとは直接の関わりがない要素のために使われているのであれば、ランキングに影響することは通常ないと考えていい。

しかし、そのJavaScriptが、重要なコンテンツのレンダリングに関わっていればランキングに影響することがありうる。

もっとも、コンテンツの生成に大切な役割を果たすJavaScriptを、検索エンジンをブロックした状態で外部サイトに置くことは、一般的にはないだろうとは思うのだが。

「トップページ vs. 下層ページ」被リンクの適切な比率とは?

そんなものありません(グーグル ウェブマスター向けヘルプフォーラム)

次のような質問が公式ヘルプフォーラムに投稿された。

問題を引き起こしそうな外部リンクを削除または否認したいのですが、そうするとトップページへのバックリンクよりも下層ページへのバックリンクの数が多くなってしまいます。

「下層ページ >トップページ」のような比率でも大丈夫でしょうか?

トップページの被リンク数よりも下層ページの被リンク数が多くなることは、何ら問題ない。普通にある状況なので、大丈夫だ(ただし、不自然なリンクが含まれていないことが前提)。

「トップページへのリンク 対 下層ページへのリンク」の適切な比率など、そもそも存在しない。

これに限らず、

- 1記事の文字数

- 1日の更新頻度

- キーワード出現率

など定まった数値を求めようとする思考は、特にSEOに取り組み始めた時期にはありがちだ。しかし、ほとんどの場合、明確な答えはないし、考える価値すらないものも多い。「常識的に、自然に、普通にやればいい」が回答だ。

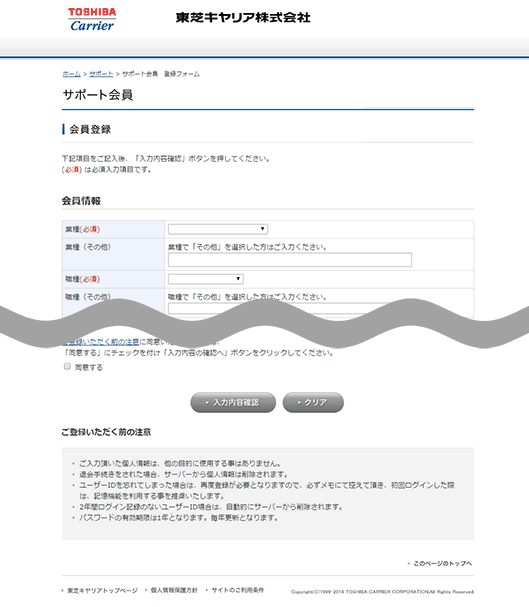

ショッピングカートでクレジットカード情報の入力を楽にするTIPS

番号にはカード会社情報が含まれている(EFO・フォーム改善ブログ)

購入手続き中のクレジットカードの情報入力フォームのTIPSを解説した記事。

不必要な情報の入力を省くのがフォーム最適化のコツの1つだ。クレジットカードの入力フォームでは、クレジットカード会社の選択がまず該当する。

なぜなら、カード番号にはクレジットカード会社を表す情報が含まれているからだ。クレジットカード番号を入力すれば必然的にどのクレジットカード会社が発行したカードなのかがわかる仕組みになっている。

記事では、入力した番号に応じてカード会社のロゴを表示させたり、カードそのものを各会社のデザインに変化させたりするさらに進んだ方式も紹介している。

クレジットカード番号を入力せずにクレジットカードで支払うことはできない。クレジットカード会社の選択はまさしく無駄な手順だ。

ショッピングカートの“カゴ落ち”率を減らすためにも参考にしたい。

![海外SEO情報ブログ]() 海外SEO情報ブログの

海外SEO情報ブログの

掲載記事からピックアップ

ウェブマスター向けオフィスアワーでのグーグル社員のアドバイスを解説した記事を今週は2つピックアップ。

- ページを削除したときは404と410のどちらを返すべきか? =>どちらでもいい

標準設定の404でOK - URLを日本語にすべきか? => UXの観点から日本語のほうがいいかもしれないがSEOとは関係ない

個人的には日本語URLは好きじゃない

- 検索結果でフェイスブックページにリッチスニペットが表示されるようになった

- フランチャイズ店のサイトを定形フォーマットにすると重複コンテンツになる

- パンダのアルゴリズムはリアルタイム更新の能力あり。更新しないのはデータの問題があるため

- 開発検証用サイトを検索結果に出さないための3つの方法

- リッチスニペットのガイドライン違反で手動対策を受けた珍しい事例

- 今週はお休み

- 今週のピックアップ

- 日本語で読めるSEO/SEM情報

- 海外SEO情報ブログの掲載記事から

- 海外のSEO/SEM情報を日本語で

- SEO Japanはお休みです

海外のSEO/SEM情報を日本語でピックアップ

検索結果でフェイスブックページにリッチスニペットが表示されるようになった

ローカルビジネスは検索結果で目立つチャンス(LocalVisibilitySystem.com)

グーグルの検索結果でフェイスブックページにリッチスニペットが表示されるようになった。

対象は、Facebookページの「レビュー」だ。たとえば上図の渋谷エクセルホテル東急ならば、Facebookページには次のようなレビューが表示されている。

このページを構造化データテストツールで検証すると、リッチスニペット用の構造化データでマークアップされていることがわかる

一般的に、リッチスニペットは検索結果で視線を引く。レストランやホテルなど地域系ビジネスを営んでいるならば、フェイスブックページでレビューをたくさん集めれば、集客に一役買ってくれるかもしれない。

フランチャイズ店のサイトを定形フォーマットにすると重複コンテンツになる

適切に扱われるが、誘導ページにならないように注意(English Google Webmaster Central office-hours hangout)

重複コンテンツと誘導ページに関係するグーグルによるQ&Aを紹介する。

6月30日に開催された英語版ウェブマスター向けオフィスアワーで、参加者が次のように質問した。

同じ商品を販売しているフランチャイズ店がたくさんある。だけど異なる都市で経営している。

各フランチャイズ店では、定形のデザインのウェブサイトで同じようなコンテンツを公開している。

サイトにnoindex robots meta タグを付けるべきか、それともこのままにしておいて構わないか? ペナルティを受けることはあるか?

グーグルのジョン・ミューラー氏は次のように回答した。

一般的に言えば、重複コンテンツだとしてみなし、それ相応に適切に扱うだろう。

自動的にペナルティを与えるということはないが、どのページがクエリに最も関連していて、どのページを検索結果に表示すべきかを、グーグルは、それぞれの検索ユーザーが求めていることに応じて判断しようとする。

今回のようなケースでは、「ビジネスの種類 + 場所」のクエリでそれぞれの場所を基にしてどのサイトを出すかを判断するはずだ。

ただし、誘導ページにならないようにするように注意する必要がある。

それぞれのフランチャイズ店が独自にサイトを運用するのだったら構わない。

しかし、そうではなく、同じ会社が都市それぞれにドメイン名を登録してサイトを作っていたとしたら、私たちはおそらく誘導ページだとして手動対策のアクションをとるだろう。

フランチャイズのように同じビジネスをいろいろな場所で営む形態があり、それぞれのフランチャイズ店ごとにウェブサイトを作るとする。

その場合、サイトの体裁が似ていて、さらに本部の用意した共通のコンテンツを使うことだろう。しかしそれでも必ず、フランチャイズ店ごとに独自のコンテンツを掲載するようなルールにするべきだ。単に住所や地名など固有の店舗情報だけを入れ替えるだけならば、重複コンテンツとしてみなされる可能性が高い。

もっとも、重複だとみなされること自体は重大な問題にはならないこともある。フィルタ(重複した検索結果の除外)が働き、複数のページが同時に検索結果に表示されることはなくなるだろうが、地域名が入った検索では適切なページが検索結果に選ばれるだろう。

だが最終的にユーザーがアクセスするページが同じで、単にそのページへたどり着かせるための通過ページとして、地域名の掛けあわせキーワードで上位表示させようと目論んでいたとしたら、誘導ページとして判断される可能性が高い。誘導ページを排除するアルゴリズムや手動対策の対象になりそうだ。

パンダのアルゴリズムはリアルタイム更新の能力あり。更新しないのはデータの問題があるため

いよいよ今週末に更新を実行か?(Google Webmaster Central Sprechstunden-Hangout)

パンダアップデートはリアルタイムでの自動更新なのか、特定のタイミングでの手動更新なのか、情報が錯綜していた。その状況について、7月2日に開催されたドイツ語版のウェブマスター向けオフィスアワーでの質問にグーグルのジョン・ミューラー氏が答えた。

パンダアップデートは今は定期的に更新していると私は理解しているのだが、それは正しいか?

ジョン・ミューラー氏の回答は次のとおりだ。

複雑な問題で、混乱させるような説明を私たちはしてきてしまったように思う。

アルゴリズム自体は定期的に更新できるように設計されている。しかししばらくの間、データを更新できずにいる。つまり技術的には定期的にアップデート可能なのだが、さまざまな理由があって定期更新ができていない。

これに対する「更新のためのデータがないと機能しないのか?

」という質問に、ミューラー氏は次のように答えた。

そのとおりだ。もう少し早く更新できると望んでいるのだが、そううまくいかないことも、時としてある。

しかし状況は良くなっていている。今週か来週かはわからないが、とにかく次のアップデートは間もなくだ。

パンダアップデートのアルゴリズム自体はリアルタイム更新に対応している。だが、更新を実行させるために必要な最新のデータに問題があるようだ。

データの収集に問題があるのかもしれないし、集めたデータの前処理に問題があるのかもしれない。あるいは、まったく別の問題かもしれない。

先週末にアップデートが実行されるかもしれないと予想したのだが、外れてしまった。先週末は米国の独立記念日で、アップデートを実行するのにふさわしいタイミングではなかったようだ。となると、いよいよ今週末あたりだろうか?

開発検証用サイトを検索結果に出さないための3つの方法

どこまで厳密にアクセス制限するかで選ぶ(WebmasterWorld)

開発検証用サイトを検索エンジンにインデックスさせないようにするにはどんな方法がベストだろうか?

このような質問がWebmasterWorldフォーラムに投稿された。

ベテランメンバーの1人は、次のような3つの方法を提示した。

- IPアドレス制限

- パスワード認証

- noindex robots meta タグ

いわく、上から理想順だとのこと(このメンバーが考える理想であり、3つすべてを併用することもできる)。

筆者からの補足を交えて説明しよう。

IPアドレス制限は、あらかじめ設定したIPアドレスのコンピュータからのアクセスだけを許可するものだ。検索エンジンのクローラや無関係な外部の人のIPアドレスからはアクセスできない。

ただし、チェック用にサイトを確認するコンピュータのIPアドレスが固定でない場合は手間がかかってしまうのが問題だ。

パスワード認証は正しいパスワードを入力しないとアクセスできない仕組みだ。クローラが正しいパスワードで認証できるはずがないので、この方法でもインデックスを防げる。

ただし一般的に使われる「ベーシック認証」はパスワードがネットワーク上に平文で送信されるため、第三者に開発中サイトを見られる危険がゼロではない。「ダイジェスト認証」にするか、またはHTTPSにするのがいいだろう。

noindex robots metaタグは検索結果に表示しないようにするためのHTMLタグだ。

先の2つとは異なりアクセス制限の機能ではないので、URLを知っていればだれでも自由にアクセスできる。だがheadセクションにタグを1行記述するだけなので、最も簡単に検索でヒットしないようにする設定だといえる。

なおrobots.txtでのアクセス制限も可能だ。しかし、条件によっては検索結果に出てくることがありうる。

ここで取り上げた以外にも方法はあるので、検索エンジンのインデックスを防ぐことに加えて、第三者に対してどこまでセキュリティを高めるかによって、採用する方法を考えるといいだろう。

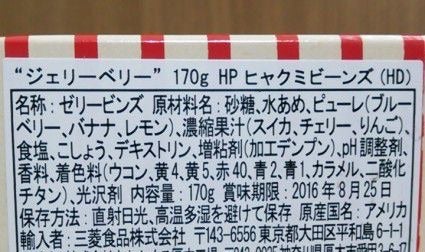

リッチスニペットのガイドライン違反で手動対策を受けた珍しい事例

対処はリッチスニペット非表示(Search Engine Roundtable)

リッチスニペットの品質ガイドラインに違反したために、グーグルに手動対策を与えられた事例がSearch Engine Landの寄稿記事で紹介された。

構造化データに関するグーグルのポリシーには次のように書かれている。

ガイドラインが定める基準を満たしていない場合は、アルゴリズムまたは手動による対策を適用することがあります。

だがリッチスニペットのガイドライン違反が原因で手動対策を実際に与えられた事例が表に出てくるのは、かなり珍しい。筆者は過去に1件あったのを知っているだけだ。よほどひどい乱用・悪用だったに違いない。

ただ、手動による対策の中身はリッチスニペットを非表示にするだけのようだ。検索順位を下げたり、まして検索結果から削除するような対処ではないらしい。リッチスニペットはランキングとは関係ないので、もっともといえばもっともなのだが。

![SEO Japan]() SEO Japanの

SEO Japanの

掲載記事からピックアップ

更新がなかったため今週もお休み。

※このコンテンツはWebサイト「Web担当者Forum - 企業ホームページとネットマーケティングの実践情報サイト - SEO/SEM アクセス解析 CMS ユーザビリティなど」で公開されている記事のフィードに含まれているものです。

オリジナル記事:常時HTTPSにすると過去記事のいいね!数がゼロになってしまう問題の解決策 など10+2記事 | 海外&国内SEO情報ウォッチ | Web担当者Forum

Copyright (C) IMPRESS CORPORATION, an Impress Group company. All rights reserved.

忙しい人のためのこの記事の使い方:

忙しい人のためのこの記事の使い方: